被美国禁售的A100、H100和MI250人工智能芯片的核心功能与AI应用开发

随着人工智能技术的飞速发展,高性能AI芯片成为推动行业进步的关键。美国禁售的NVIDIA A100、H100以及AMD的MI250芯片,均是当前市场上顶尖的AI加速器。这些芯片不仅在计算能力上表现卓越,还在人工智能应用软件的开发中扮演着核心角色。本文将详细介绍这些芯片的主要功能,并探讨它们在AI软件开发中的应用。

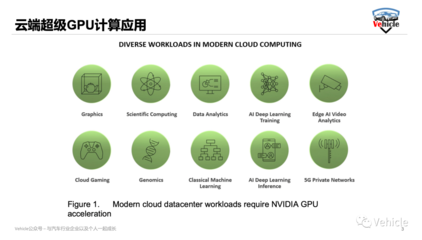

让我们了解这些芯片的基本特性和能力。NVIDIA A100基于Ampere架构,专为数据中心和AI工作负载设计。它支持大规模并行计算,具有高吞吐量和低延迟的特点,适用于训练和推理任务。A100的Tensor Core技术可加速矩阵运算,在处理深度学习模型时显著提升性能。它支持多实例GPU(MIG)功能,允许多个任务共享单个GPU资源,提高了资源利用率。NVIDIA H100作为A100的继任者,基于Hopper架构,进一步提升了性能,尤其是在Transformer模型等大型AI模型上,通过新的FP8数据格式和动态编程技术,实现了更高的能效和速度。AMD MI250则基于CDNA2架构,专为高性能计算和AI设计,拥有强大的矩阵计算能力和高带宽内存,适合大规模AI训练和科学模拟。这些芯片的共同点是能够处理海量数据,加速复杂算法,为AI应用提供强大的算力基础。

在人工智能应用软件开发方面,这些芯片的应用范围极为广泛。例如,在自然语言处理(NLP)领域,A100和H100可以加速大型语言模型(如GPT系列或BERT)的训练和推理过程。开发者可以利用这些芯片的并行计算能力,快速处理数十亿参数的模型,提升聊天机器人、翻译系统和内容生成应用的响应速度与准确性。在计算机视觉应用中,MI250和A100能够高效处理图像识别、物体检测和视频分析任务,支持自动驾驶、医疗影像诊断等关键行业。这些芯片还广泛应用于推荐系统、金融风险分析和药物发现等领域,通过优化算法执行,缩短开发周期并降低成本。

从开发工具角度看,NVIDIA提供了CUDA和cuDNN等软件栈,与A100和H100深度集成,使开发者能够轻松编写和优化AI代码。AMD则通过ROCm平台支持MI250,提供类似的开发环境。利用这些工具,软件开发者可以构建高效的AI模型,实现从数据预处理到模型部署的全流程加速。尽管这些芯片面临禁售限制,但它们在AI应用软件开发中的核心作用不可忽视,推动了人工智能技术的边界扩展,并催生了众多创新应用。随着替代技术的兴起,全球AI生态可能会进一步多样化,但这些高性能芯片的遗产将继续影响行业发展。

如若转载,请注明出处:http://www.jgaqjc.com/product/19.html

更新时间:2026-06-01 20:24:54